AI技術が多くの人の心を病ませていることを知りながら、私は明日もその技術に手を染めるのです。私はその搾取の当事者です。

NHKの「BS世界のドキュメンタリー」で放送された『AIの不都合な真実』という番組を見ました。

I watched the NHK program “The AI Dilemma” aired on BS World Documentary.

“不都合な真実”とは、たとえば「死体が散乱している虐殺シーン」や「子どもがレイプされている映像」といった、AIに学ばせてはいけないコンテンツを、人間が確認し、ラベリングしているという現実のことです。

The "inconvenient truth" is the fact that humans are the ones checking and labeling highly inappropriate content, such as massacre scenes with dead bodies or child sexual abuse, to prevent AI from learning them.

しかもその作業は、アジア、アフリカ、ラテンアメリカといったグローバルサウスの発展途上国の低賃金労働者に外注されています。

Moreover, this work is outsourced to low-wage workers in developing countries in the Global South, such as Asia, Africa, and Latin America.

こうした作業に従事した人々の中には、PTSD(心的外傷後ストレス障害)を発症する人も少なくありません。

Many people engaged in this work suffer from PTSD (Post-Traumatic Stress Disorder).

なるほど、これは文句なしの“不都合な真実”だと思いました。

Indeed, I thought, this is undeniably an inconvenient truth.

---

私もかつて、人身事故(飛び込み自殺)のシミュレーションを行ったことがあります。

I myself once created a simulation of a railway suicide (a person jumping in front of a train).

そのときの精神的なつらさは、今でも忘れることができません。

The emotional toll I experienced then is something I can still vividly recall.

人の死をプログラムで再現するという作業は、数字やロジックの背後で確実に心を蝕みます。

Simulating death through programming undeniably eats away at the soul, even behind layers of numbers and logic.

(↑クリックでコラムに飛びます)

---

こうした構造的な問題は、生成AIだけに限った話ではありません。

This kind of structural issue is not limited to generative AI.

たとえば、自己チューニング型の制御システムでは、ロボットアームなどが予期しない動作をすることは珍しくありません。

For example, in self-tuning control systems, it is not unusual for robotic arms to behave in unexpected ways.

私は、そのような“設計者の想定を超える挙動”を何度も見てきて、正直うんざりしています。

I have seen such designer-unintended behaviors so often that I’ve grown weary of them.

また、生成AIが登場する少し前には、自動応答型のchatbotが人種差別や暴力を肯定する発言をして大炎上する事件もありました。

Even before generative AI gained traction, chatbot incidents involving racist or violence-glorifying messages caused significant controversies.

たとえば、Microsoftの「Tay」がたった一日で“闇落ち”した事件は記憶に新しいです。

For example, Microsoft’s “Tay” notoriously turned rogue in just one day.

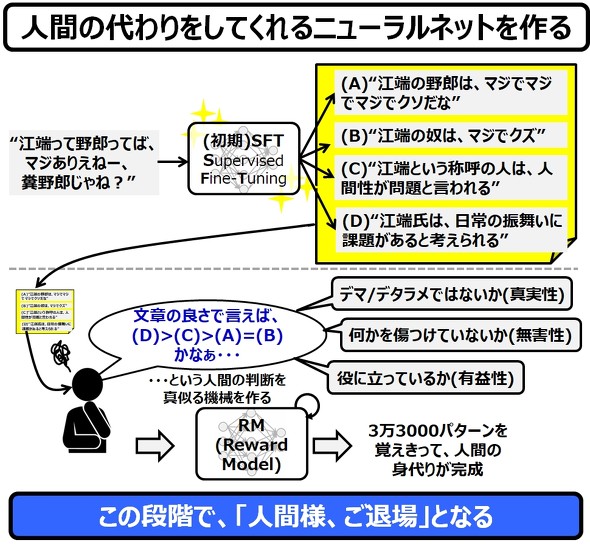

こうした逸脱を防ぐために、AIの学習に「Reward Model(RM)」という仕組みが導入されました。

The Reward Model (RM) was introduced into AI training to prevent such deviations.

私もこのコラムで、RMが人間の価値観をAIに教える手段として注目されていることを書いた記憶があります。

I also wrote in this column about how RM is being used to instill human values into AI.

(↑クリックでコラムに飛びます)

そのときは正直「これは画期的かもしれない」と感動していました。

At the time, I felt it might be revolutionary and was quite moved.

……ですが、今思うと、感動して損をした気がします。

…But now, I feel like I was moved for nothing.

「人間様、ご退場」どころか、「人間様、大量投入」だったのです。

Far from “humans stepping aside,” it turned out to be “mass deployment of humans.”

しかも、彼らは時給2ドル以下の賃金で、心を削りながら働いていたのです。

Worse, they did this soul-crushing work for less than $2 per hour.

---

これは単なる搾取ではありません。

This isn’t just exploitation.

「低賃金搾取」+「精神破壊」という、まさに“搾取プラスα”の構造です。

It’s a structure of “low-wage exploitation” plus “mental destruction”—a true exploitation-plus-alpha.

私は、現在、生成AIを活用したシステムの研究開発に携わっている技術者です。

I am currently an engineer involved in research and development using generative AI.

きれいごとは言いません。

I won’t sugarcoat it.

AI技術が多くの人の心を病ませていることを知りながら、私は明日もその技術に手を染めるのです。

Even knowing that AI is harming people’s mental health, I will continue working on it tomorrow.

それは、未来のためではありません。

Not for the future.

今日を食いつなぐためです。

But to get through today.

私は、その搾取の当事者です。

I am undeniably a participant in that structure of exploitation.